Réussir distinguer une vraie vidéo d’une vidéo générée par l’intelligence artificielle devient un défi de plus en plus complexe. Ces dernières années, ce qu’on appelle faux profondc’est-à-dire que ces contenus synthétiques qui imitent des personnes, des voix et des situations réelles, ont atteint des niveaux de réalisme qui peuvent potentiellement tromper n’importe qui. Aujourd’hui, les outils de génération de vidéos basés sur des modèles de machine learning permettent même à ceux ayant des compétences techniques peu avancées de créer des vidéos convaincantes. En conséquence, des vidéos artificielles circulent de plus en plus sur les réseaux sociaux : il peut s’agir de clips amusants avec des animaux imaginaires, mais aussi de faux discours de célébrités et de personnalités publiques ou, encore une fois, de prétendus enregistrements d’événements qui ne se sont jamais produits, de véritables contrefaçons historiques astucieusement créées pour générer de la désinformation. Dans cette analyse approfondie, nous tenterons de vous dérouler quelques conseils pratiques pour tenter de reconnaître les vidéos générées avec l’IA. On parle d’« essayer » car les vidéos générées avec l’IA ont atteint un tel niveau de réalisme qu’il n’est pas toujours possible d’établir avec certitude la nature de la vidéo qui passe sous notre objectif.

Comment reconnaître une vidéo réalisée avec l’IA

Que sont les deepfakes et pourquoi il est de plus en plus difficile de les reconnaître

Pour comprendre comment nous orienter dans ce scénario, nous devons d’abord comprendre de quoi nous parlons. Avec la date limite faux profondfusion de mots anglais apprentissage profond (une technique avancée d’apprentissage automatique) e fauxc’est-à-dire faux, sont indiqués vidéos, images ou audio générés par des algorithmes qui imitent l’apparence ou la voix d’une personne réelle. Ces systèmes analysent de grandes quantités de données pour reproduire les mouvements du visage, les expressions et le timbre vocal avec une grande précision.

Alors qu’il y a encore un an ou deux il était beaucoup plus facile d’identifier le caractère artificiel de ces vidéos, aujourd’hui les choses sont différentes. La technologie s’améliore très rapidement. Et les derniers modèles peuvent créer des vidéos haute définition avec des mouvements crédibles, un éclairage réaliste et un son parfaitement synchronisé. Des outils comme Sora 2, développé par OpenAI, ou Veo 3, conçu par Google, représentent des exemples emblématiques de cette évolution : ils produisent des clips d’une grande qualité visuelle et des scènes cohérentes d’un point de vue narratif. Certains incluent des fonctionnalités (comme « Cameo » de Sora 2) qui vous permettent d’utiliser les ressemblances d’autres personnes et de les insérer dans presque toutes les scènes générées par l’IA.

3 conseils pratiques pour reconnaître les vidéos réalisées avec l’IA

Maintenant que ce qu’est une vidéo deepfake et comment elle est générée est un peu plus clair, voyons voir 3 conseils pour reconnaître les deepfakes réalisés avec l’IA.

Identifier la présence d’un filigrane

Un premier indice utile pourrait être le présence d’un filigranec’est-à-dire un signe graphique appliqué automatiquement au contenu. Certaines plateformes incluent un logo ou un symbole pour indiquer que la vidéo a été créée avec des outils d’intelligence artificielle. Dans le cas du contenu produit avec Sora, par exemple, les vidéos téléchargées depuis l’application incluent une icône « nuage » qui se déplace le long des bords de l’image. C’est une sorte d’étiquette visuelle qui indique l’origine du contenu. Mais attention : ce n’est pas une garantie absolue. Si le filigrane est statique, il peut être découpé et supprimé, et il existe un logiciel capable de supprimer même les filigranes animés (comme celui de Sora) en quelques clics. Pour cette raison, l’absence de filigrane n’indique pas nécessairement que la vidéo que nous regardons est authentique.

Analyser les métadonnées des fichiers

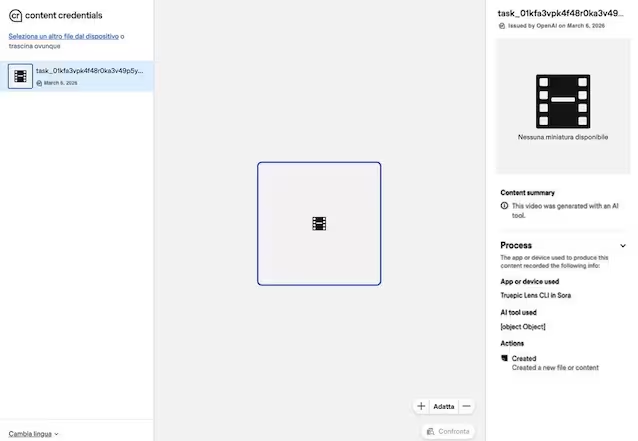

Une méthode plus technique consiste àanalyser les métadonnées du fichier. Avec ce mot, nous indiquons toute une série d’informations qui accompagnent automatiquement le contenu numérique lors de sa création. Les métadonnées peuvent inclure le type d’appareil utilisé, la date et l’heure de l’enregistrement, l’emplacement géographique ou le logiciel qui a généré le fichier. Certaines vidéos créées avec des modèles d’IA contiennent des indicateurs spécifiques qui révèlent leur origine. Par exemple, le contenu des « marques » de Google généré avec ses modèles d’IA avec le système ID de synthétiseur. Quant aux vidéos générées avec Sora 2, elles sont cependant marquées de métadonnées C2PApuisque OpenAI (la société qui développe Sora) fait partie du Coalition pour la provenance et l’authenticité du contenu. Voici un mini-guide sur la façon de vérifier les métadonnées dans les deux cas.

- Visitez cette page de Site ContentAuthenticité.

- Téléchargez le fichier que vous souhaitez vérifier en cliquant sur Sélectionnez un fichier sur votre appareil ou en le faisant glisser dans le boîte en pointillés.

- Vérifiez le informations dans le panneau de droite. Si le contenu est généré par l’IA, vous devriez voir un résumé sur la droite similaire à celui que vous voyez dans l’exemple de capture d’écran suivant.

Alternativement, vous pourriez télécharger la vidéo sur Gemini et demandez à Google AI si le film contient des métadonnées SynthID.

Cependant, il est bon de garder un fait à l’esprit : ces outils de détection d’IA ne sont pas infaillibles. Cela signifie que même une vidéo générée par l’IA ne peut pas être signalée comme telle par ces détecteurs de métadonnées.

Réaliser une analyse critique de la vidéo

A côté des outils techniques tels que ceux mentionnés ci-dessus, nous pouvons également compter surobservation critique de la vidéo. Dans les deepfakes les plus sophistiqués, il n’est peut-être pas facile d’identifier les indices qui trahissent le caractère artificiel du contenu, mais si la vidéo est imparfaite et présente des micro-défauts, les identifier peut contribuer à alimenter les soupçons. Te voilà 7 indices que vous devriez essayer de repérer:

- Éclairage ou ombres irréalistes.

- Peau excessivement lisse.

- Dents ou yeux légèrement déformés.

- Reflets artificiels sur les verres.

- Clignotement irrégulier.

- Expressions émotionnelles rigides ou « plates ».

- Le son n’est pas parfaitement synchronisé avec le mouvement des lèvres.

Naturellement ces signes ne sont pas toujours évidentsnotamment dans les vidéos générées avec les technologies les plus avancées. Pour cette raison, il est conseillé d’intégrer l’analyse visuelle à l’analyse des métadonnées (comme déjà mentionné précédemment) ainsi qu’à une vérification des faits et des éventuelles déclarations présentées dans la vidéo faisant l’objet de l’analyse. Par exemple, si la vidéo montre un homme politique faisant certaines déclarations, rechercher sur Google les phrases exactes qu’il a prononcées peut vous permettre de trouver des correspondances ou non, ce qui peut donner des indices supplémentaires sur l’origine du contenu. Ce processus de vérification, typique du travail journalistique, reste l’un des outils les plus efficaces même pour les utilisateurs « ordinaires ».