Là Mode de verrouillage by ChatGPT a été créé pour répondre à un problème de sécurité concret qui apparaît lorsque les systèmes d’intelligence artificielle commencent à interagir de manière profonde avec le Web et les applications externes. Ce mode de protection avancé et facultatif est conçu pour un petit nombre d’utilisateurs à haut risque et réduit considérablement la possibilité d’exposition des données en limitant strictement les interactions de l’IA avec le monde extérieur. L’objectif est d’atténuer une classe d’attaques de plus en plus pertinente, celle de ce qu’on appelle injection rapidedans lequel un acteur malveillant tente de manipuler le comportement du modèle en l’amenant à suivre des instructions inattendues ou à divulguer des informations sensibles provenant des systèmes attaqués.

Parallèlement au mode verrouillage, de nouvelles étiquettes arrivent également « Risque élevé » qui indiquent, directement dans l’interface, les fonctions qui entraînent un profil de sécurité plus délicat. Analysons-le un peu plus en détail pourquoi ces outils ont été introduits, comment ils fonctionnent et comment ils aident les utilisateurs et les entreprises à prendre des décisions plus éclairées concernant l’utilisation de l’IA connectée au réseau.

Comment fonctionne le mode de verrouillage sur ChatGPT

Lorsqu’un système d’IA communique uniquement avec l’utilisateur, le périmètre de risque est relativement contrôlable. Les choses changent, et beaucoup, lorsque le modèle peut naviguer en ligne, interroger des services externes ou agir via des applications connectées. Dans ce contexte, le phénomène de injection rapide devient potentiellement concret. Grâce à cette technique, les attaquants peuvent exploiter un contenu externe (par exemple, une page Web ou une entrée apparemment anodine) pour « injecter » des instructions conçues pour inciter le modèle à effectuer des actions indésirables, comme si l’utilisateur les avait légitimement données. Cela entraîne de multiples risques, notamment l’exfiltration potentielle de données, c’est-à-dire la fuite non autorisée d’informations vers des tiers (cybercriminels).

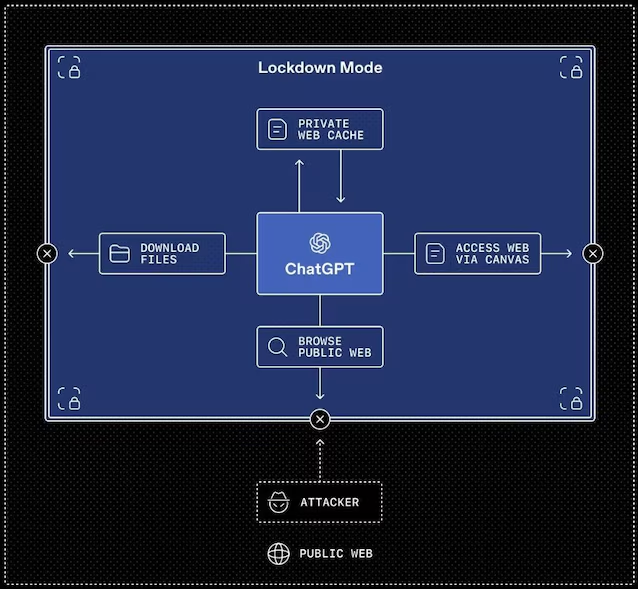

Là Mode de verrouillage répond à ce scénario avec une approche déterministe, c’est-à-dire basée sur des règles rigides et prévisibles. En l’activant, certaines fonctionnalités de ChatGPT sont limitées ou désactivées si un contrôle strict des flux de données ne peut être garanti. Un exemple clé est le Navigation sur le Web: en mode Lockdown, l’accès à Internet est limité au contenu présent dans le cache, évitant ainsi les requêtes réseau en temps réel vers le Web. En termes simples, cela signifie qu’il est beaucoup plus complexe pour les attaquants d’obtenir des données et des informations et, lorsque ce niveau de garantie n’est pas réalisable, la fonction de navigation Web ChatGPT est simplement désactivée.

Ce paramètre il n’est pas conçu pour l’utilisateur moyenmais pour profils particulièrement exposés tels que les dirigeants, les responsables de la sécurité ou les équipes gérant des données critiques. Ce n’est pas un hasard si le mode Lockdown se « greffe » sur les protections déjà présentes dans les plans Enterprise, qui incluent des techniques telles que le sandboxing (l’isolement de l’exécution dans des environnements contrôlés), les contrôles contre l’exfiltration basée sur les URL et les systèmes de surveillance et d’audit.

Il est initialement disponible pour les utilisateurs qui ont ChatGPT Entreprise, ChatGPT Édu, ChatGPT pour les soins de santé Et ChatGPT pour les enseignantset peut être géré par les administrateurs en créant des rôles spécifiques et en appliquant des restrictions supplémentaires au-delà des politiques standard. Concernant l’extension du nouveau mode de sécurité à tous les autres utilisateurs, OpenAI a déclaré :

Nous prévoyons de rendre le mode verrouillage accessible aux utilisateurs grand public dans les mois à venir.

Un aspect notable est le contrôle granulaire des applications connectées. Étant donné que de nombreux flux de travail métier dépendent d’intégrations externes, les administrateurs peuvent décider précisément quelles applications et actions sont autorisées lorsque le mode de verrouillage est activé.

Il obtient également le label « Risque élevé » pour la sécurité

Aux côtés du Lockdown Mode, un deuxième élément important arrive : l’introduction systématique deLabel « risque élevé » pour certaines fonctionnalités qui, bien qu’utiles, élargissent la surface d’attaque. Les fonctions qui nécessitent un accès au réseau ou à des ressources externes sont signalées de manière cohérente dans ChatGPT, ChatGPT Atlas et Codex, accompagnées d’explications claires sur les changements et les risques introduits.

L’objectif est de clarifier immédiatement quand une fonction spécifique implique un plus grand risque pour la sécurité : comme le rapporte OpenAI, cependant, ces les étiquettes ne sont pas définitives et peut être supprimé au fil du temps.